实时深度渲染音频/视觉 iOS 应用程序

品牌

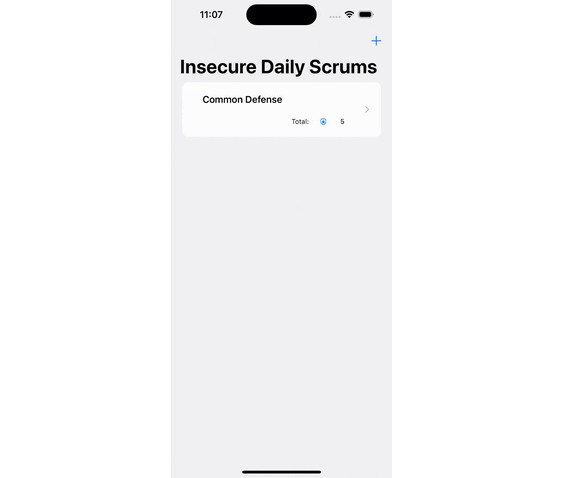

实时深度渲染音频/视觉 iOS 应用程序。将 2D 图像转换为可交互的 3D 点云。

这是我前一段时间制作的 iOS 应用程序、macOS 应用程序。除了展示一些技术和某种抽象艺术展览之外,没有任何内在的实用性。

想要开源这个为 xrOS 和任何可能想要一个潜在创建混合现实体验的起点做准备的人。此 Repo 将根据 xrOS 的新知识和更新进行更新。相应地,MarbleKit 和 GlassKit 也将更新以支持应用程序之外的渲染和音频端,因为此演示应用程序依赖于这两个 Swift 包。

重要的

还没有在 M-CHIP Mac 上测试过,因为我的个人仍然是英特尔

这个应用程序使用我的GraniteUI的存档设计模式。如果您想使用它,请注意我不会再更新它,因为我会继续使用我最新的Granite。在原生 SwiftUI 应用程序中,组件应该仍然是可分离和容易提取的,以满足您自己的个人需求。

一个不公开并已从应用程序中删除的包是MarqueKit。我[CAN REMOVE]在使用该工具包的各个位置发表了评论。它用于编码和解码,因为图像是应用程序中与其他用户共享信息的主要形式。

因此,应用程序中的某些功能可能无法使用。

全部

- 清理代码(其他项目遗留下来的大量代码)

- 清理评论

- 完成引导部分

- 解耦指南(将 GraniteUI 组件转换为原生 SwiftUI 视图)

要求

macOS 11.0+建立传递🟢iOS 14.0+未经测试🟡

技术

- 金属

- 核心数据

- 核心ML

- 斯威夫特用户界面

- 苹果扩展

- 分享

- 行动

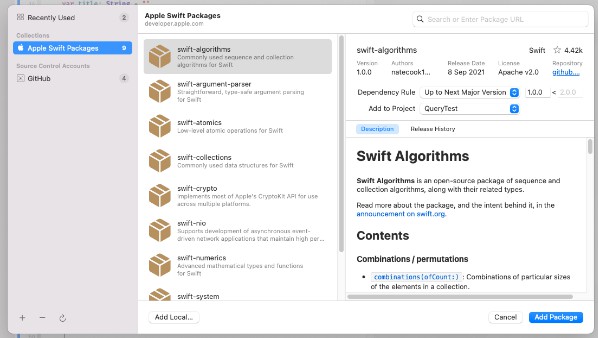

斯威夫特包

指导

[在制品]

学分

一些代码已从其他来源重新归属,随着时间的推移收集。有些没有评论标题,因为我意识到相同的代码也来自其他来源。在这里,我将链接其中一些逻辑的确切学分。

地点:/Resources/Design/System

@Brett-Best的纯 Swift UI

https://github.com/CodeSlicing/pure-swift-ui

@NeoTeo的SwiftBase58

https://github.com/NeoTeo/SwiftBase58/

深度图是从基于此的自定义量化 CoreML 模型 (67Mb) 生成的

地点:/Core/Exhibition/AI

MiDaS by @isl-org

https://github.com/isl-org/MiDaS

测试歌曲,Glass是我的,没有版权。